《昇思25天学习打卡营第5天 | 网络构建》

目录

- 《昇思25天学习打卡营第5天 | 网络构建》

- 什么是神经网络模型

- 构建一个用于Mnist数据集分类的神经网络模型

- 定义模型类

- 模型层

- nn.Flatten

- nn.Dense

- nn.ReLU

- nn.SequentialCell

- nn.Softmax

- 模型参数

想要学习神经网络模型的构建,我们要先对神经网络模型有一个简单的了解

什么是神经网络模型

神经网络模型是一种模仿生物神经系统结构和功能的计算模型,它由大量的节点(或称为“神经元”)组成,这些节点通过连接(或称为“权重”)相互作用,以处理信息。神经网络模型是机器学习和深度学习的核心组成部分,广泛应用于图像识别、语音识别、自然语言处理、游戏和决策系统等领域。

神经网络模型的基本结构包括以下几个关键部分:

- 1.输入层(Input Layer):输入层接收原始数据或特征,并将其传递给网络。每个输入节点对应数据的一个特征。

- 2.隐藏层(Hidden Layers):隐藏层位于输入层和输出层之间,可以有一个或多个。每个隐藏层包含多个神经元,这些神经元通过激活函数处理输入数据,并将结果传递给下一层。

- 3.输出层(Output Layer):输出层产生网络的最终输出。输出层的节点数量取决于任务的类型,例如,分类任务中可能有一个节点对应一个类别。

- 4.权重(Weights):权重是神经网络中连接神经元的边的强度。在训练过程中,权重会根据学习算法进行调整,以最小化预测输出和实际输出之间的差异。

- 5.激活函数(Activation Function):激活函数决定神经元是否应该被激活,以及如何将输入信号转换为输出信号。常见的激活函数包括Sigmoid、Tanh、ReLU等。

- 6.损失函数(Loss Function):损失函数衡量模型预测值与真实值之间的差异。训练的目标是最小化损失函数,以提高模型的准确性。

- 7.优化算法(Optimization Algorithm):优化算法用于调整权重,以减少损失函数的值。常见的优化算法包括梯度下降(Gradient Descent)、Adam等。

神经网络模型可以通过增加隐藏层的数量和每层的神经元数量来构建更深层次的网络,即深度神经网络(DNN)。深度学习是指使用这些深度神经网络进行学习和预测的过程。随着网络深度的增加,模型可以学习到更复杂的数据表示,从而提高其在复杂任务上的性能。

神经网络模型的训练通常涉及以下步骤:

初始化权重和偏置。

通过网络前向传播输入数据,计算输出。

计算损失函数的值。

通过反向传播算法计算梯度,更新权重和偏置。

重复上述步骤,直到损失函数达到预定的阈值或训练次数达到预定值。

神经网络模型的灵活性和强大的学习能力使其成为解决各种复杂问题的有力工具。

构建一个用于Mnist数据集分类的神经网络模型

神经网络模型是由神经网络层和Tensor操作构成的,mindspore.nn提供了常见神经网络层的实现,在MindSpore中,Cell类是构建所有网络的基类,也是网络的基本单元。一个神经网络模型表示为一个Cell,它由不同的子Cell构成。使用这样的嵌套结构,可以简单地使用面向对象编程的思维,对神经网络结构进行构建和管理。

import mindspore

from mindspore import nn, ops

定义模型类

当我们定义神经网络时,可以继承nn.Cell类,在__init__方法中进行子Cell的实例化和状态管理,在construct方法中实现Tensor操作。

construct意为神经网络(计算图)构建,相关内容详见使用静态图加速。

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512, weight_init="normal", bias_init="zeros"),

nn.ReLU(),

nn.Dense(512, 512, weight_init="normal", bias_init="zeros"),

nn.ReLU(),

nn.Dense(512, 10, weight_init="normal", bias_init="zeros")

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

构建完成后,实例化Network对象,并查看其结构

model = Network()

print(model)

Network<

(flatten): Flatten<>

(dense_relu_sequential): SequentialCell<

(0): Dense<input_channels=784, output_channels=512, has_bias=True>

(1): ReLU<>

(2): Dense<input_channels=512, output_channels=512, has_bias=True>

(3): ReLU<>

(4): Dense<input_channels=512, output_channels=10, has_bias=True>

构造一个输入数据,直接调用模型,可以获得一个十维的Tensor输出,其包含每个类别的原始预测值。

model.construct()方法不可直接调用。

X = ops.ones((1, 28, 28), mindspore.float32)

logits = model(X)

# print logits

logits

Tensor(shape=[1, 10], dtype=Float32, value=

[[ 5.63525222e-03, 1.95503701e-03, 1.37578510e-03 … 3.18193645e-03, 4.75832634e-03, -1.40827773e-02]])

在此基础上,我们通过一个nn.Softmax层实例来获得预测概率。

pred_probab = nn.Softmax(axis=1)(logits)

y_pred = pred_probab.argmax(1)

print(f"Predicted class: {y_pred}")

Predicted class: [0]

模型层

本节中我们分解上节构造的神经网络模型中的每一层。首先我们构造一个shape为(3, 28, 28)的随机数据(3个28x28的图像),依次通过每一个神经网络层来观察其效果。

input_image = ops.ones((3, 28, 28), mindspore.float32)

print(input_image.shape)

(3, 28, 28)

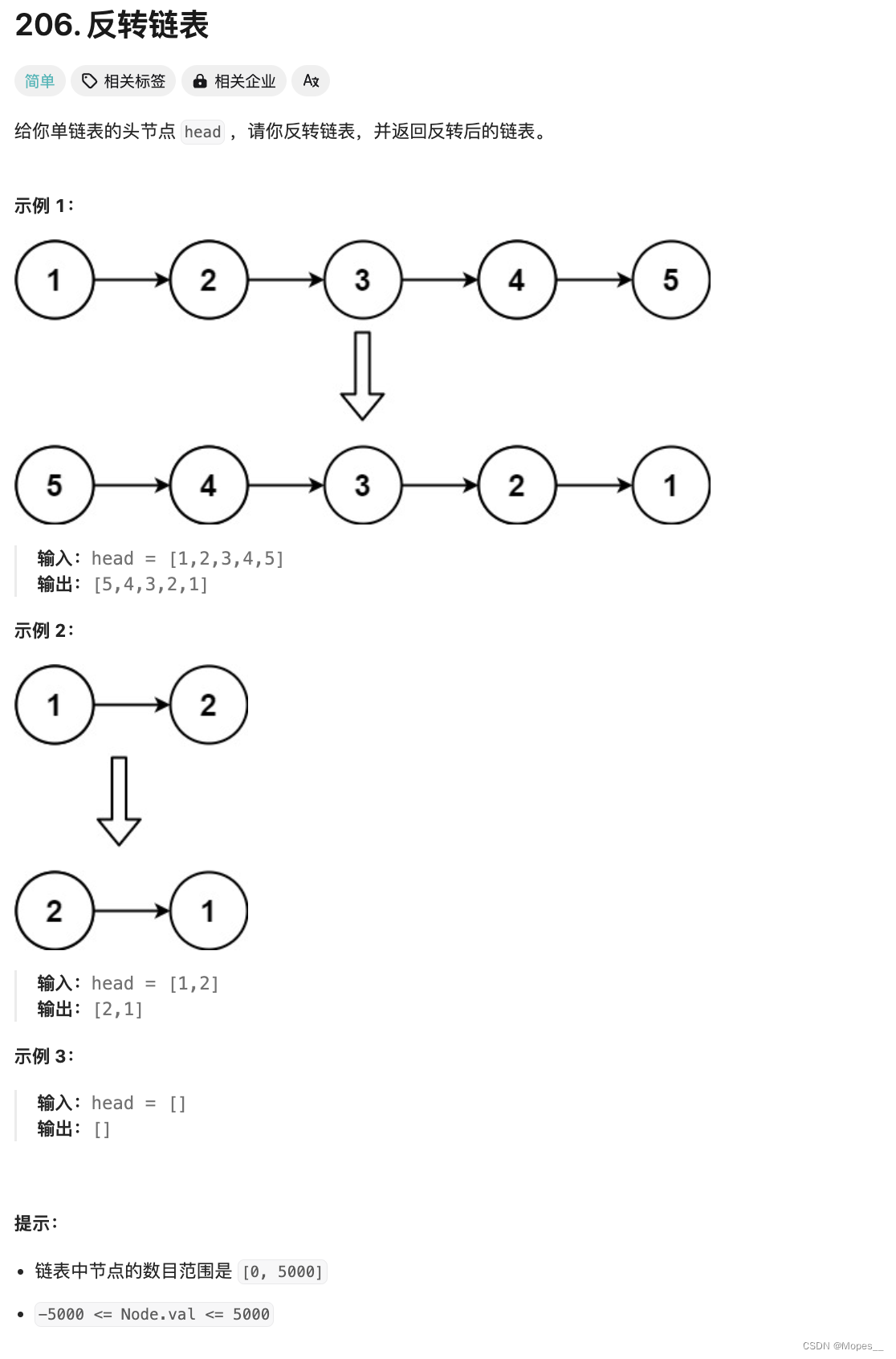

nn.Flatten

实例化nn.Flatten层,将28x28的2D张量转换为784大小的连续数组。

flatten = nn.Flatten()

flat_image = flatten(input_image)

print(flat_image.shape)

(3, 784)

nn.Dense

nn.Dense为全连接层,其使用权重和偏差对输入进行线性变换。

layer1 = nn.Dense(in_channels=28*28, out_channels=20)

hidden1 = layer1(flat_image)

print(hidden1.shape)

(3, 20)

nn.ReLU

nn.ReLU层给网络中加入非线性的激活函数,帮助神经网络学习各种复杂的特征。

print(f"Before ReLU: {hidden1}\n\n")

hidden1 = nn.ReLU()(hidden1)

print(f"After ReLU: {hidden1}")

Before ReLU: [[-0.09974532 0.43209994 -1.5348294 -0.01862794 -0.34712428 -0.7054299

-0.7356559 -0.4894955 0.5345057 0.39337468 -0.4733568 0.75652665

-0.1487863 -0.06488393 -0.43578142 0.37262595 -0.47728366 -0.03433053

-0.98210937 0.5067057 ]

[-0.09974532 0.43209994 -1.5348294 -0.01862794 -0.34712428 -0.7054299

-0.7356559 -0.4894955 0.5345057 0.39337468 -0.4733568 0.75652665

-0.1487863 -0.06488393 -0.43578142 0.37262595 -0.47728366 -0.03433053

-0.98210937 0.5067057 ]

[-0.09974532 0.43209994 -1.5348294 -0.01862794 -0.34712428 -0.7054299

-0.7356559 -0.4894955 0.5345057 0.39337468 -0.4733568 0.75652665

-0.1487863 -0.06488393 -0.43578142 0.37262595 -0.47728366 -0.03433053

-0.98210937 0.5067057 ]]

After ReLU: [[0. 0.43209994 0. 0. 0. 0.

0. 0. 0.5345057 0.39337468 0. 0.75652665

0. 0. 0. 0.37262595 0. 0.

0. 0.5067057 ]

[0. 0.43209994 0. 0. 0. 0.

0. 0. 0.5345057 0.39337468 0. 0.75652665

0. 0. 0. 0.37262595 0. 0.

0. 0.5067057 ]

[0. 0.43209994 0. 0. 0. 0.

0. 0. 0.5345057 0.39337468 0. 0.75652665

0. 0. 0. 0.37262595 0. 0.

0. 0.5067057 ]]

nn.SequentialCell

nn.SequentialCell是一个有序的Cell容器。输入Tensor将按照定义的顺序通过所有Cell。我们可以使用SequentialCell来快速组合构造一个神经网络模型。

seq_modules = nn.SequentialCell(

flatten,

layer1,

nn.ReLU(),

nn.Dense(20, 10)

)

logits = seq_modules(input_image)

print(logits.shape)

(3, 10)

nn.Softmax

最后使用nn.Softmax将神经网络最后一个全连接层返回的logits的值缩放为[0, 1],表示每个类别的预测概率。axis指定的维度数值和为1。

softmax = nn.Softmax(axis=1)

pred_probab = softmax(logits)

模型参数

网络内部神经网络层具有权重参数和偏置参数(如nn.Dense),这些参数会在训练过程中不断进行优化,可通过 model.parameters_and_names() 来获取参数名及对应的参数详情。

print(f"Model structure: {model}\n\n")

for name, param in model.parameters_and_names():

print(f"Layer: {name}\nSize: {param.shape}\nValues : {param[:2]} \n")

输出

Model structure: Network<

(flatten): Flatten<>

(dense_relu_sequential): SequentialCell<

(0): Dense<input_channels=784, output_channels=512, has_bias=True>

(1): ReLU<>

(2): Dense<input_channels=512, output_channels=512, has_bias=True>

(3): ReLU<>

(4): Dense<input_channels=512, output_channels=10, has_bias=True>

>

>

Layer: dense_relu_sequential.0.weight

Size: (512, 784)

Values : [[-0.00198828 0.00976331 -0.00121677 ... 0.00152741 0.01949361

-0.00351514]

[ 0.00710773 0.01324592 0.00197527 ... -0.01315448 -0.00343975

-0.00046103]]

Layer: dense_relu_sequential.0.bias

Size: (512,)

Values : [0. 0.]

Layer: dense_relu_sequential.2.weight

Size: (512, 512)

Values : [[ 1.63047947e-02 -9.95626251e-05 -3.21123237e-03 ... 2.22095232e-02

-8.22230522e-03 -5.10709640e-03]

[-1.89869397e-03 -7.83220772e-03 -4.89277160e-03 ... 1.33626405e-02

-2.49107648e-03 -2.77312868e-03]]

Layer: dense_relu_sequential.2.bias

Size: (512,)

Values : [0. 0.]

Layer: dense_relu_sequential.4.weight

Size: (10, 512)

Values : [[-1.0803971e-02 -1.2106386e-03 -9.3358625e-03 ... -7.1796784e-03

-7.5424239e-03 -1.5704501e-02]

[ 6.8407003e-03 -6.9631526e-05 8.0867661e-03 ... 8.8249799e-03

-1.3077988e-02 8.5207196e-03]]

Layer: dense_relu_sequential.4.bias

Size: (10,)

Values : [0. 0.]

![[数据集][目标检测]人员状态跑睡抽烟打电话跌倒检测数据集4943张5类别](https://img-blog.csdnimg.cn/direct/57fa108f6ccf48e8b54115adccbcf8bd.png)